Quando a IA vê perigo onde não há: o que confunde os algoritmos numa mamografia de rotina

Imagine que você treina um detetive para reconhecer suspeitos observando milhões de rostos. Ele fica muito bom nisso. Mas, de vez em quando, ele para alguém na rua com toda a convicção — e a pessoa é completamente inocente. O problema não é que o detetive é ruim. É que alguns rostos inocentes têm traços que, por algum motivo, ele aprendeu a associar com perigo. Para melhorar o trabalho dele, você precisa entender exatamente quais são esses traços. É mais ou menos isso que um grupo de pesquisadores noruegueses fez com dois algoritmos de inteligência artificial usados no rastreamento de câncer de mama.

O estudo, publicado em maio de 2026 na European Radiology, analisou 130.031 mamografias de triagem de 42.371 mulheres que participaram do programa BreastScreen Norway entre 2008 e 2018. Os pesquisadores não estavam interessados em saber se a IA era boa em detectar câncer — isso já se estuda bastante. Eles queriam entender o que há de especial nas imagens que recebem pontuação altíssima de risco mesmo quando nenhum câncer aparece nos seis anos seguintes.

O que significa “alto risco” para uma IA de mamografia

Os dois modelos de inteligência artificial avaliados no estudo — chamados simplesmente de modelo A e modelo B — foram desenvolvidos para detectar câncer em mamografias de rastreamento. Cada imagem recebe uma pontuação de risco: quanto mais alta, mais a IA acredita que algo está errado. Os pesquisadores se concentraram nos 5% superiores dessa escala, ou seja, os casos em que os dois algoritmos mais gritaram “atenção”.

Dentro desse grupo de altíssimo risco, eles separaram dois conjuntos de 120 mamografias cada. No primeiro, a IA deu alarme máximo — mas nenhum câncer foi encontrado nos seis anos seguintes. No segundo, a IA também deu alarme máximo e, dessa vez, havia de fato um câncer detectado pelo rastreamento. Depois disso, radiologistas experientes revisaram todas as imagens sem saber de antemão em qual grupo cada uma estava, e descreveram o que viram: densidade do tecido mamário, tipo de estrutura marcada pela IA, e sua própria interpretação clínica.

Em outras palavras, a pergunta era direta: quando a IA erra e quando acerta, o que ela estava olhando em cada caso?

Calcificações: o rastro que engana o algoritmo

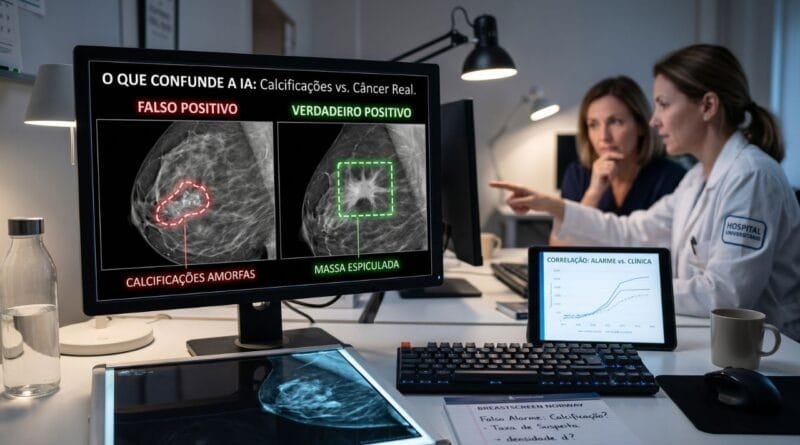

O achado mais marcante do estudo está nos casos em que não havia câncer. Nesses 120 exames com alarme falso, a característica que mais chamou a atenção dos algoritmos foram calcificações isoladas — pequenos depósitos de cálcio que aparecem como pontinhos brancos na mamografia. O modelo A as marcou em 72% dos casos desse grupo; o modelo B, em 68%.

Aqui vale uma analogia, ainda que imperfeita. Pense numa detector de metais num aeroporto. Ele foi calibrado para reagir a objetos metálicos porque armas são metálicas. Mas moedas no bolso também disparam o alarme — não porque sejam perigosas, mas porque compartilham uma propriedade que o detector aprendeu a associar com risco. As calcificações são, de certa forma, as “moedas no bolso” dos algoritmos de mamografia: elas têm aparência que pode se sobrepor à de achados malignos, especialmente quando surgem em agrupamentos. A analogia quebra aqui porque, ao contrário das moedas, algumas calcificações de fato indicam malignidade — portanto o alarme nem sempre é injustificado, mas nesse grupo específico ele foi.

O detalhe que torna tudo mais interessante é que, quando os radiologistas revisaram essas mesmas imagens, 76% delas foram interpretadas como benignas ou provavelmente benignas — ou seja, a impressão clínica humana ia na direção oposta ao alarme da máquina. As calcificações tinham morfologia amorfa e distribuição em agrupamento, características que os radiologistas reconheceram como padrão benigno com bastante confiança. Além disso, o grupo de alarmes falsos tinha maior proporção de mamas densas (11% com densidade BI-RADS d, a mais alta) comparado ao grupo com câncer real (3%). Tecido denso é conhecido por dificultar tanto a leitura humana quanto, aparentemente, o julgamento do algoritmo.

Quando a IA acerta: o papel da massa espiculada

No grupo em que havia câncer de verdade, o cenário era diferente. A característica mais frequente entre os tumores detectados foi a massa espiculada, presente em 29% dos casos. Uma massa espiculada tem bordas irregulares que se projetam para fora como raios de uma estrela — é uma das assinaturas mais reconhecíveis de malignidade em mamografia, e sua presença eleva o índice de suspeita tanto para humanos quanto para algoritmos.

Portanto, há uma distinção razoavelmente clara emergindo dos dados: quando a IA acerta nos casos mais graves, ela parece estar respondendo a estruturas que os radiologistas também considerariam suspeitas. Quando ela erra, parece estar reagindo a calcificações que, na avaliação humana, têm aparência benigna. Isso sugere que os dois modelos avaliados podem estar com seus limiares de detecção calibrados de forma a priorizar sensibilidade — ou seja, errar pelo excesso de alarme, não pela omissão.

No entanto, o estudo não permite afirmar com segurança por que os algoritmos se comportam assim internamente. Redes neurais profundas não explicam suas decisões em linguagem que um radiologista reconheceria. O que os pesquisadores fizeram foi observar a correlação entre o alarme e o achado imagiológico — não dissecar o raciocínio da máquina. Essa limitação é importante: saber o que a IA marca não é a mesma coisa que saber por que ela marca.

O que isso muda na prática — e o que ainda está em aberto

A consequência mais direta desse tipo de análise é a possibilidade de refinar os limiares de ativação dos algoritmos. Se calcificações com morfologia amorfa e distribuição em agrupamento são responsáveis por uma fração expressiva dos falsos positivos, é possível, em tese, ajustar os modelos para que esse padrão específico receba menor peso — ou seja, reduza a taxa de alarmes desnecessários sem comprometer a detecção dos casos verdadeiramente suspeitos.

Na prática do rastreamento, falsos positivos têm custo real: mulheres são convocadas para exames adicionais, passam por biópsias que não encontrarão nada, e carregam semanas de ansiedade por um alarme que nunca deveria ter soado. Reduzir essa taxa, portanto, não é apenas uma questão técnica de desempenho algorítmico — é uma questão de cuidado com a paciente.

Ainda assim, o estudo tem limites que os próprios autores reconhecem. Os dados vêm de um único programa de rastreamento, em um país específico, ao longo de um período delimitado. Resta descobrir se esse padrão de comportamento — calcificações benignas como principal fonte de alarme falso — se repete em populações com perfis de densidade mamária diferentes, ou com algoritmos treinados em outros conjuntos de dados. Também não se sabe, por enquanto, se os ajustes de limiar que funcionariam para um modelo valeriam igualmente para o outro.

Por outro lado, o método em si — caracterizar sistematicamente o que os algoritmos estão “vendo” nos casos de alto risco — aponta um caminho promissor. Em vez de tratar a IA como uma caixa preta que apenas acerta ou erra, esse tipo de análise começa a abrir a caixa pelas beiradas, mapeando os padrões de confusão com a precisão descritiva que a radiologia já domina. Afinal, entender onde um instrumento falha é tão valioso quanto documentar onde ele acerta.

Baseado em “High risk score of breast cancer by artificial intelligence (AI) on screening mammograms: a review of negative and cancer cases” publicado por European Radiology em 06/05/2026.

Link: https://link.springer.com/article/10.1007/s00330-026-12579-4

Conteúdo informativo. Não substitui avaliação clínica especializada.

Foto de SHVETS production no Pexels (https://www.pexels.com/photo/a-person-writing-on-a-document-in-front-of-a-desktop-8413332/)